DLSS 4 Multi-Frame Generation e il PSSR di PlayStation

Tre frame generati per ogni reale e la risposta su misura di Sony sulla PS5 Pro.

Questo capitolo racconta due storie su generazioni di frame generation arrivate sul mercato nel 2024–2025: la DLSS 4 Multi-Frame Generation di NVIDIA (PC, RTX serie 50) e il PSSR di Sony PlayStaSation Spectral Super Resolution sulla PlayStation 5 Pro (hardware console basato su una RDNA custom).

Sono approcci molto diversi a un problema simile: un SoC console chiuso, di fascia alta, con un budget di silicio fisso vs. un ecosistema PC senza tetti con le GPU con i più grandi acceleratori neurali del mondo. I trade-off scelti da ognuno sono illuminanti.

DLSS 4 Multi-Frame Generation

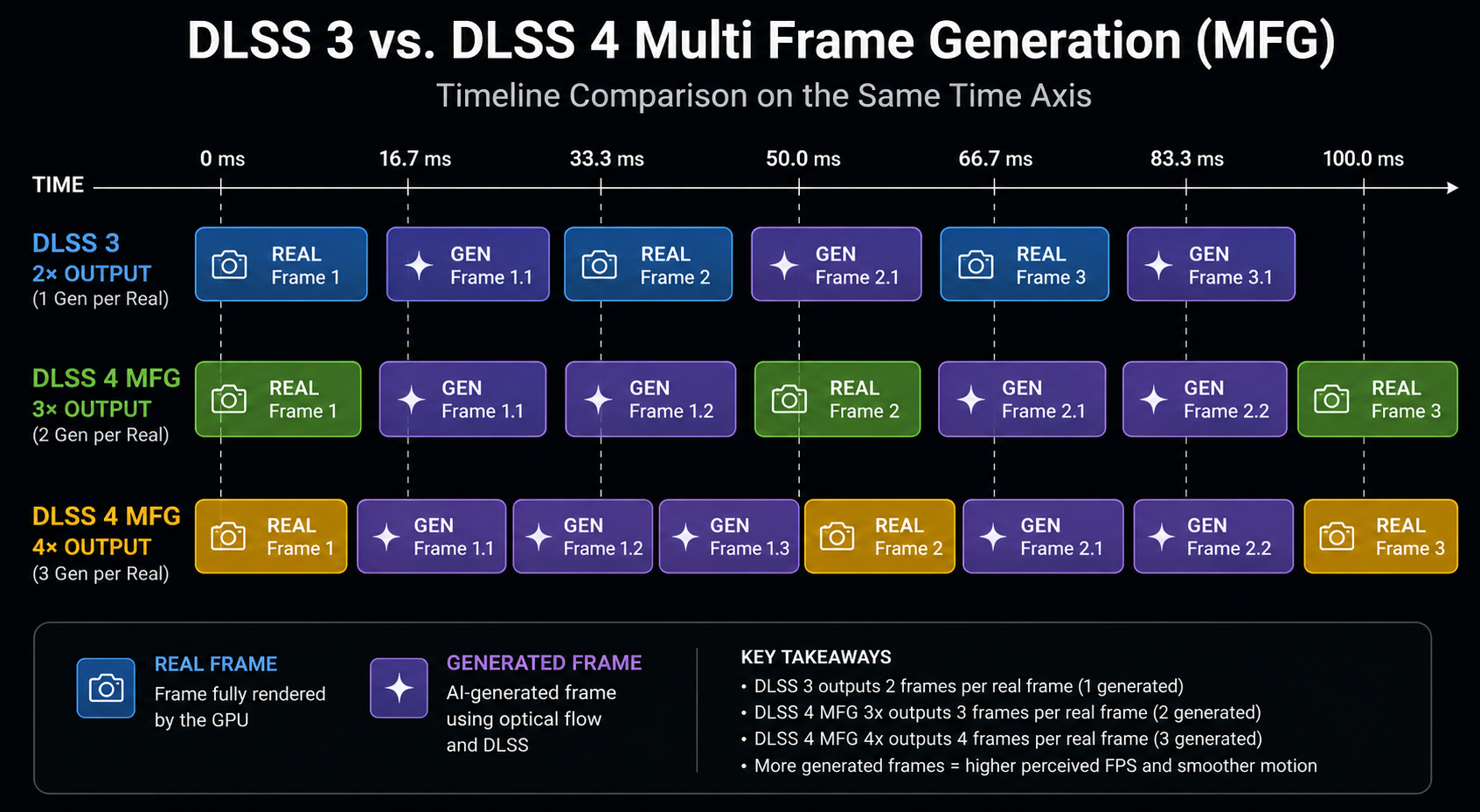

DLSS 3 inserisce un frame generato tra ogni coppia di frame renderizzati raddoppiando il display rate. DLSS 4 estende a tre frame generati tra ogni coppia di frame renderizzati, 4× il display rate.

Quindi a 60 FPS renderizzati, MFG può visualizzare a 240 FPS. A 80, spinge 320. A 100, 400. La motivazione è alimentare i pannelli OLED da 480 Hz e 540 Hz che stanno cominciando a uscire; anche la GPU più potente non può renderizzare 480 frame nativi al secondo di un gioco moderno, ma può renderizzarne 120 e far dipingere a MFG gli altri 360.

Perché è più difficile del 2× FG

Il problema di interpolazione peggiora significativamente quando spingi più frame generati tra quelli reali:

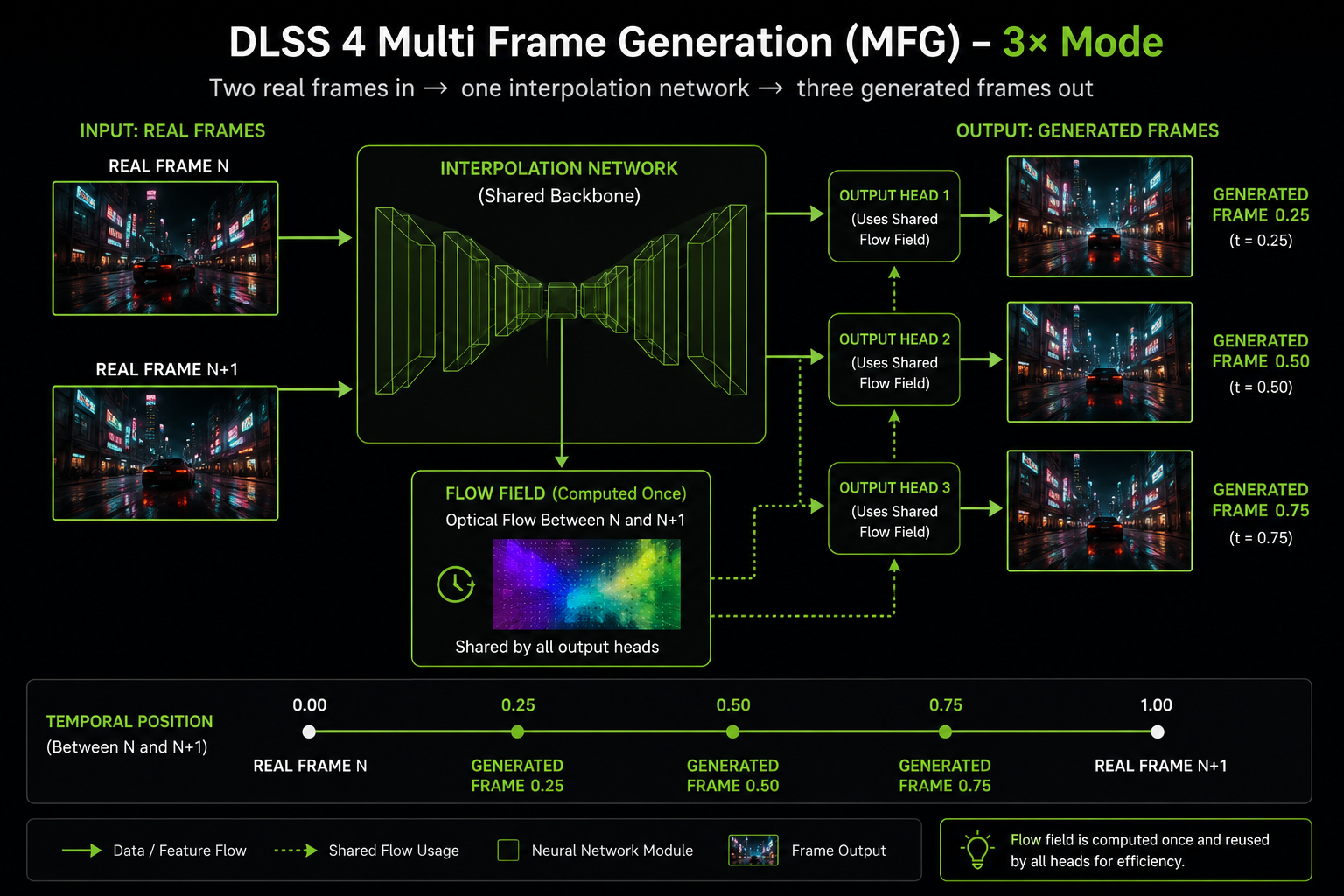

- Il gap temporale tra i campioni di motion cresce. Da 60→240, ogni frame generato è a 1/240 s dal prossimo. La rete di interpolazione deve estrapolare fette di tempo più fini, e piccoli errori nella stima del motion producono juddering visibile.

- Gli errori si compongono. Tre frame generati consecutivi significano che un errore nel campo di motion influisce su tre frame di fila, diventando più facile da percepire come artefatto sostenuto.

- L'output dell'Optical Flow Accelerator viene riusato. Calcolare l'OF quattro volte più spesso farebbe saltare il budget di tempo, quindi la rete deve condividere il campo di flow tra tre frame generati, ognuno pesato secondo la propria posizione temporale. Qualsiasi errore di flow diventa visibile tre volte.

La soluzione di DLSS 4 è una rete di interpolazione ridisegnata un vision transformer, non la CNN più vecchia che prende il campo di flow una volta, predice campi di displacement per tre posizioni temporali target e produce tutti e tre i frame in un singolo pass di inferenza fuso. Il costo è circa 1,5× il costo della FG a singolo frame, mentre produce 3× i frame generati.

Il gate hardware

MFG è uscito gated solo alle RTX serie 50 (Blackwell). La ragione dichiarata di NVIDIA: il nuovo "AI Management Processor" su Blackwell gestisce lo scheduling di più pass di inferenza intercalati più efficientemente della pipeline di Ada. Analisi indipendenti suggeriscono che il modello effettivo girerebbe su Ada, ma con frame-pacing peggiore e overhead più alto per frame generato. Come con DLSS 3 solo-Ada, questo gate è in parte tecnico e in parte segmentazione di prodotto.

PlayStation PSSR un problema diverso, una soluzione diversa

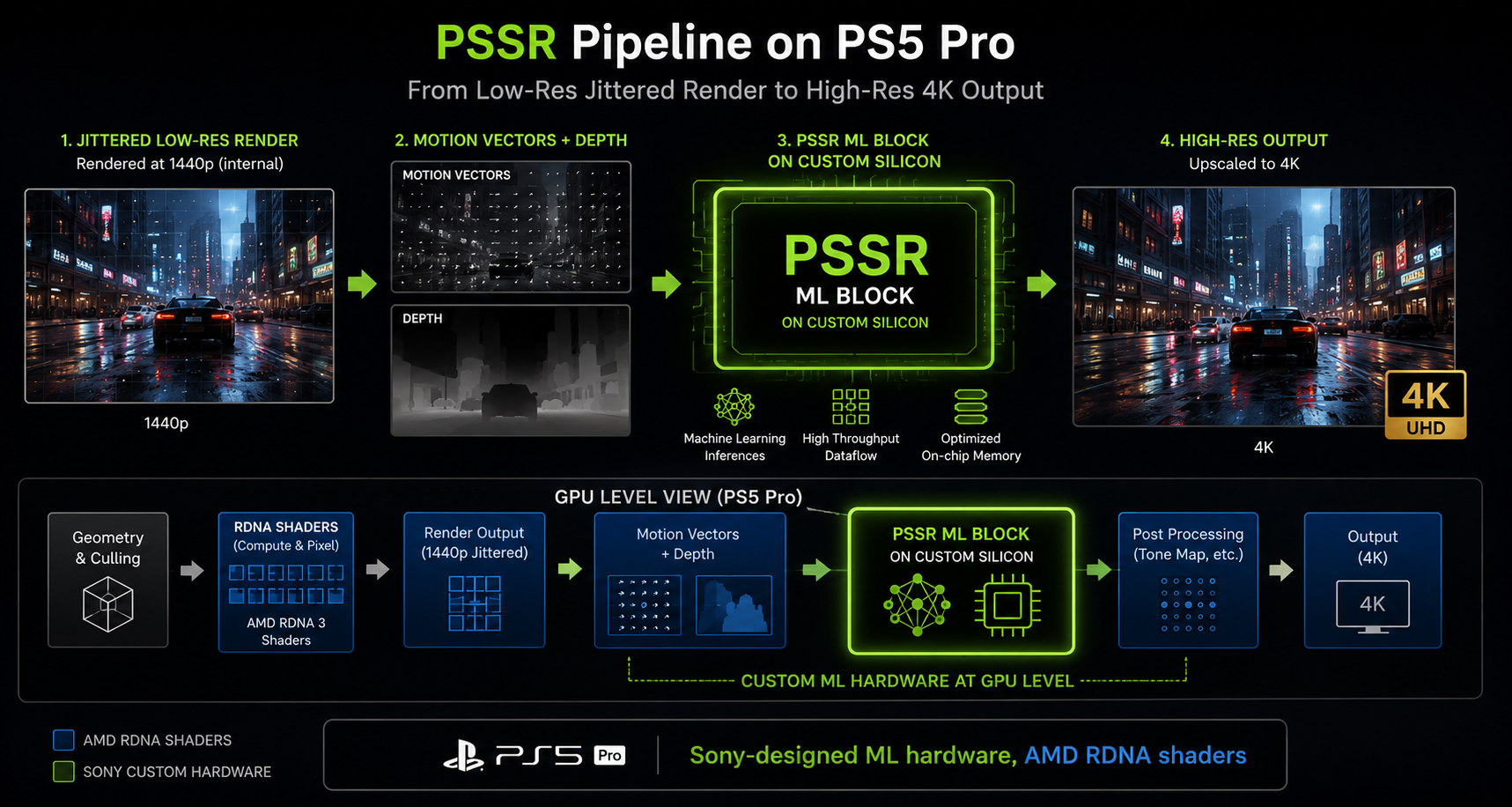

Il PSSR di Sony esce esclusivamente sulla PlayStation 5 Pro (novembre 2024). È una tecnica di AI super-resolution temporale molto nella famiglia di DLSS stessa classe di algoritmi ma addestrata, ottimizzata e dispiegata su silicio AMD custom che Sony ha co-progettato.

La GPU della PS5 Pro è all'incirca un ibrido RDNA 3 / RDNA 3.5 con blocchi hardware custom per l'accelerazione ML che le RDNA off-the-shelf di AMD non hanno. Nello specifico: un set dedicato di unità di matematica matriciale (Sony lo chiama "hardware di machine learning") che può far girare la rete neurale di PSSR a un costo di pochi millisecondi. Senza quel silicio custom, una GPU RDNA 3 open dovrebbe ricadere sugli shader core general-purpose per la stessa matematica, e il costo sarebbe proibitivo.

Cosa è PSSR

In termini di feature, PSSR è più vicino a DLSS Super Resolution 2.x: un upscaler temporale che prende un frame renderizzato a bassa risoluzione più depth, motion vectors e un buffer di history, e produce un output ad alta risoluzione. Attualmente non fa frame generation. Sony ha detto che varianti multi-frame e frame generation sono nella roadmap, ma PSSR come è shippato è una tecnica di classe Super Resolution, non di classe DLSS 3.

Alcune scelte progettuali specifiche di Sony:

- I rapporti di scala interna sono simili a DLSS Performance/Quality: render a circa 1080p–1440p, output a 4K.

- La rete è più piccola di DLSS Super Resolution in parte perché l'hardware ML sulla PS5 Pro è molto più piccolo dei Tensor Core di una 4090, in parte perché le console hanno un budget di frame stretto e prevedibile. Sony ha calibrato per ~2 ms di inferenza a output 4K.

- È addestrata specificamente su giochi PlayStation, non genericamente. Sony cura il training set da titoli first-party interni e dati forniti dai partner. Questo significa che la prior di PSSR è biased verso lo stile visivo dei giochi PS generalmente d'aiuto, ma significa che nuovi effetti visivi (es. tipi inusuali di particelle) potrebbero richiedere re-training.

- L'integrazione nel motore è imposta dal SDK PS5 Pro: un gioco che opta per "PS5 Pro Enhanced" deve cablare proiezione con jitter, motion vectors e un depth buffer all'API di PSSR. È concettualmente identico all'integrazione DLSS ma sulle API di PlayStation.

Perché Sony ha costruito il proprio invece di usare FSR

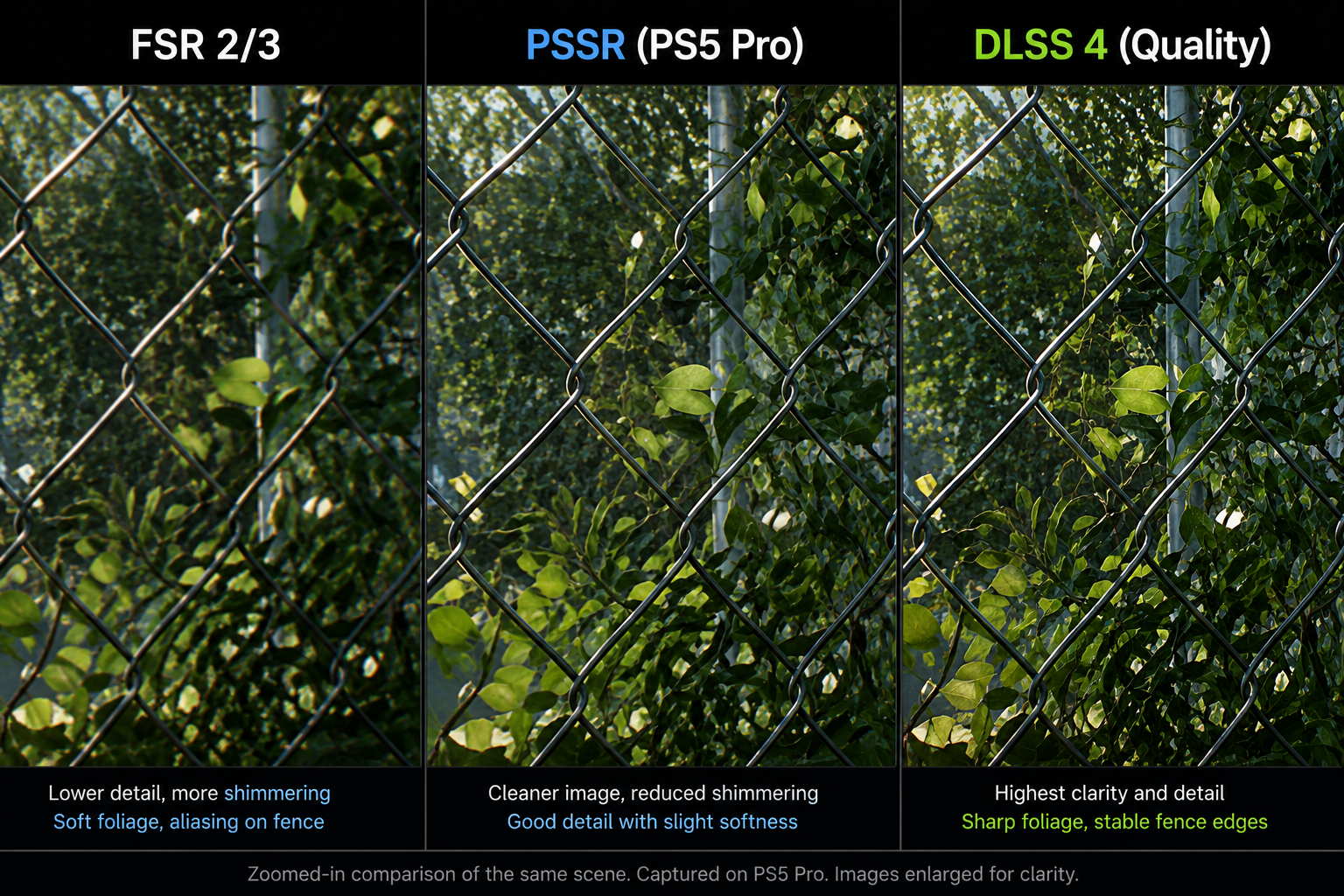

Questa è la domanda centrale. FSR 2/3 di AMD era già in spedizione cross-vendor e sarebbe stato un'opzione a costo zero per Sony.

La risposta è la qualità dell'immagine. FSR 2/3 non è un upscaler basato su rete neurale è un upscaler temporale calibrato a mano che gira su shader core general-purpose. È buono, ma è costantemente superato da DLSS nelle comparazioni indipendenti. Sony stava costruendo una console di fascia premium pubblicizzata specificamente sulla qualità d'immagine migliorata, quindi avevano bisogno di un upscaler della classe di qualità di DLSS, il che significava accettare che:

- L'hardware avrebbe bisogno di acceleratori ML (FSR non ne aveva bisogno). Quindi hanno aggiunto silicio custom.

- Avrebbero bisogno di addestrare una rete neurale. Quindi hanno costruito infrastruttura di training e dataset.

- Avrebbero bisogno di integrazione per gioco. Quindi l'hanno resa parte della certificazione "PS5 Pro Enhanced".

Il risultato è la prima piattaforma non-PC con un genuino upscaler temporale a rete neurale. Non è ancora rifinito come DLSS 4 comparazioni dirette nei titoli disponibili su entrambe le piattaforme (es. Alan Wake 2, Star Wars Outlaws) mostrano che PSSR è più vicino a DLSS 2 che a DLSS 4 nella qualità dell'immagine ma Sony itererà, esattamente come NVIDIA ha fatto attraverso DLSS 1, 2, 3, 4.

Una nota sugli artefatti di PSSR

Le prime implementazioni di PSSR hanno mostrato:

- Shimmer delle particelle: pioggia, neve e piccole particelle possono sfarfallare in movimento. È un problema di distribuzione di training e migliorerà.

- Ghosting su superfici trasparenti: vetro, acqua. Stessa causa principale di DLSS (i motion vector non descrivono bene la trasparenza), ma la rete più piccola di PSSR ha meno capacità di compensare.

- Dettaglio a frequenza più bassa nel fogliame: PSSR è più nitido di FSR ma più soft di DLSS 4 sulle feature piccole e ripetitive.

Sono le stesse classi di artefatti che DLSS 2 aveva al lancio e seguiranno la stessa curva di miglioramento.

Cosa ci insegna la comparazione

Attraverso le piattaforme nel 2026, la ricostruzione real-time sembra grossomodo così:

| Tecnica | Vendor | Classe | Frame Gen? | Hardware richiesto |

|---|---|---|---|---|

| DLSS 4 SR + MFG | NVIDIA | Neurale (transformer) | Fino a 4× | RTX serie 50 per MFG, RTX 20+ per SR |

| DLSS 3 | NVIDIA | Neurale (CNN/transformer) | 2× | RTX serie 40 per FG |

| FSR 4 | AMD | Neurale | 2× | RDNA 4 + (cross-vendor possibile) |

| FSR 3.1 | AMD | Calibrata a mano + FG | 2× | Qualsiasi GPU moderna |

| FSR 2 | AMD | Calibrata a mano | No | Qualsiasi GPU moderna |

| XeSS | Intel | Neurale (CNN) | No (per ora) | Intel Arc (full quality) / qualsiasi GPU (fallback DP4a) |

| PSSR | Sony | Neurale | No (per ora) | Solo PS5 Pro |

Due pattern sono chiari. Primo, l'industria sta convergendo su upscaler temporali neurali solo le generazioni più vecchie di FSR di AMD resistono. Secondo, la frame generation è ormai roba di base su PC ma è ancora una voce di roadmap sulle console.

Nel prossimo capitolo guardiamo più a fondo FSR e XeSS le alternative cross-vendor perché i loro vincoli di progetto rivelano cosa è difficile e cosa è facile fare questo senza silicio proprietario.