Perché Esiste la Frame Generation

I monitor sono diventati più veloci delle GPU. La frame generation è la risposta dell'industria.

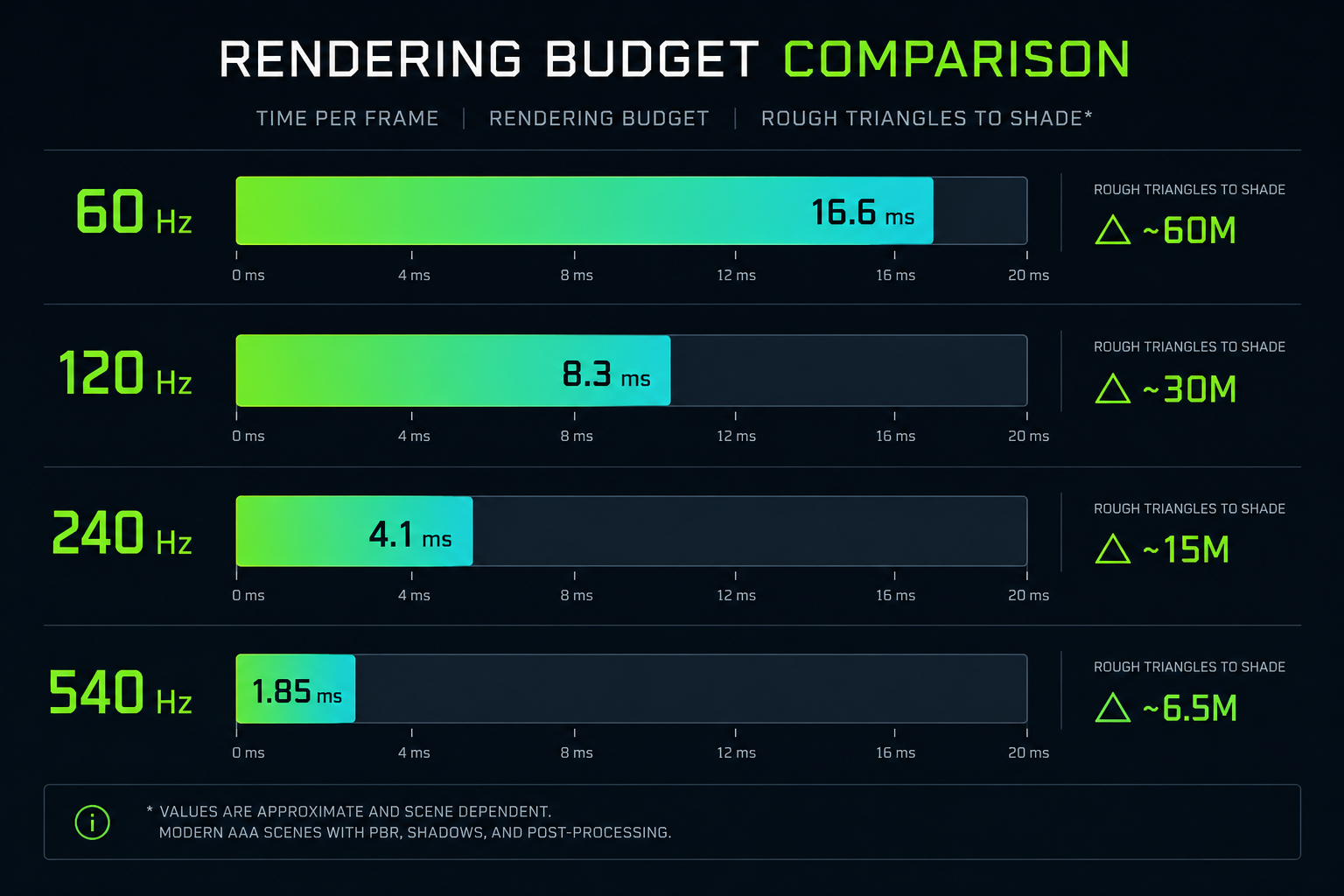

Nel 2018 un monitor da gaming di alto livello aveva un refresh di 144 Hz. Nel 2024 i pannelli da 240 Hz erano lo standard e quelli da 360–540 Hz erano già in vendita. Per alimentare onestamente quei pannelli, una GPU deve produrre un frame completo, fisicamente simulato e completamente shaded ogni 1,85 millisecondi.

Non sta succedendo. Non in 4K, non con illuminazione path-traced, non su hardware che puoi davvero comprare.

Quindi l'industria ha fatto qualcosa di diverso. Ha smesso di provare a renderizzare ogni frame da zero e ha cominciato a ricostruirli prima facendo upscaling da una risoluzione più bassa, poi inventando frame completamente nuovi tra quelli reali. Il secondo trucco è quello che chiamiamo frame generation, ed è il cambiamento più dirompente nel rendering real-time dai tempi degli shader programmabili.

Cosa è questo corso, e cosa non è

Questo è un approfondimento tecnico, non una guida alle impostazioni. Non ti diremo se usare la modalità "Quality" o "Performance" in Cyberpunk 2077. Ti diremo, nel dettaglio:

- Cosa fa davvero una GPU tra il momento in cui premi un tasto e quello in cui un fotone parte dal tuo monitor.

- Perché l'anti-aliasing tradizionale è fondamentalmente rotto e come l'accumulazione temporale lo ha silenziosamente sostituito.

- Come DLSS Super Resolution usa una rete neurale per ricostruire un'immagine 4K da un render 1080p.

- Perché DLAA è, matematicamente, la stessa rete con un input diverso.

- Come la DLSS 3 Frame Generation sintetizza un frame che non è mai stato renderizzato, usando optical flow e motion vectors.

- Come la DLSS 4 Multi-Frame Generation porta questa idea a 3 frame generati per ogni frame reale.

- Cosa fa di diverso il PSSR di Sony sulla PlayStation 5 Pro e perché un approccio console è costretto a compromessi diversi.

- Il ruolo di FSR 3 / FSR 4 di AMD e XeSS di Intel.

- Perché la frame generation aggiunge latenza anche quando alza gli FPS, e come Reflex e tecniche simili la recuperano.

- Da dove vengono ghosting, smearing e artefatti di disoccusione, a livello algoritmico.

Alla fine sarai in grado di leggere il talk GDC di uno sviluppatore sull'upscaling temporale, guardare lo screenshot di un gioco e capire più o meno quale tecnica di ricostruzione è stata usata, e spiegare a un amico con la matematica vera dietro perché un gioco a "240 fps" a volte è in realtà un gioco a 60 fps travestito.

Una nota su cosa è "AI" qui

Il marketing usa le parole AI, deep learning e rete neurale in modo intercambiabile. In questo corso saremo specifici. Quando NVIDIA dice che DLSS usa l'AI, quello che gira davvero è una rete neurale convoluzionale a volte un transformer che è stata addestrata offline su milioni di coppie di immagini (input a bassa risoluzione, ground truth ad alta risoluzione). A runtime è solo una pila di moltiplicazioni matriciali sui Tensor Cores della tua GPU. Non c'è ragionamento, non c'è "comprensione" della scena; c'è una funzione appresa che mappa pixel in pixel, e si dà il caso che lo faccia molto bene.

Guarderemo quella funzione e cosa la fa funzionare.

Prerequisiti

Dovresti essere a tuo agio con:

- L'idea che una GPU è un processore massicciamente parallelo.

- Algebra lineare di base: vettori, matrici, prodotti scalari.

- Cosa sono un pixel e un triangolo.

Tutto il resto la pipeline di rendering, i motion vector, il jitter temporale, l'optical flow, le operazioni tensoriali lo costruiremo da zero.

Nel prossimo capitolo faremo un crash course veloce in computer graphics, giusto quanto basta perché il resto della serie poggi su qualcosa di solido.