Artefatti, Casi Limite e il Futuro

Come leggere un artefatto di frame-generation, e dove sta andando il campo.

Abbiamo camminato da un singolo triangolo sullo schermo fino a una rete transformer che inventa interi frame mai renderizzati. In questo capitolo finale leghiamo tutto classificando gli artefatti che vedrai davvero ognuno tracciabile fino a uno stage specifico della pipeline e guardando avanti a dove sta andando la ricostruzione.

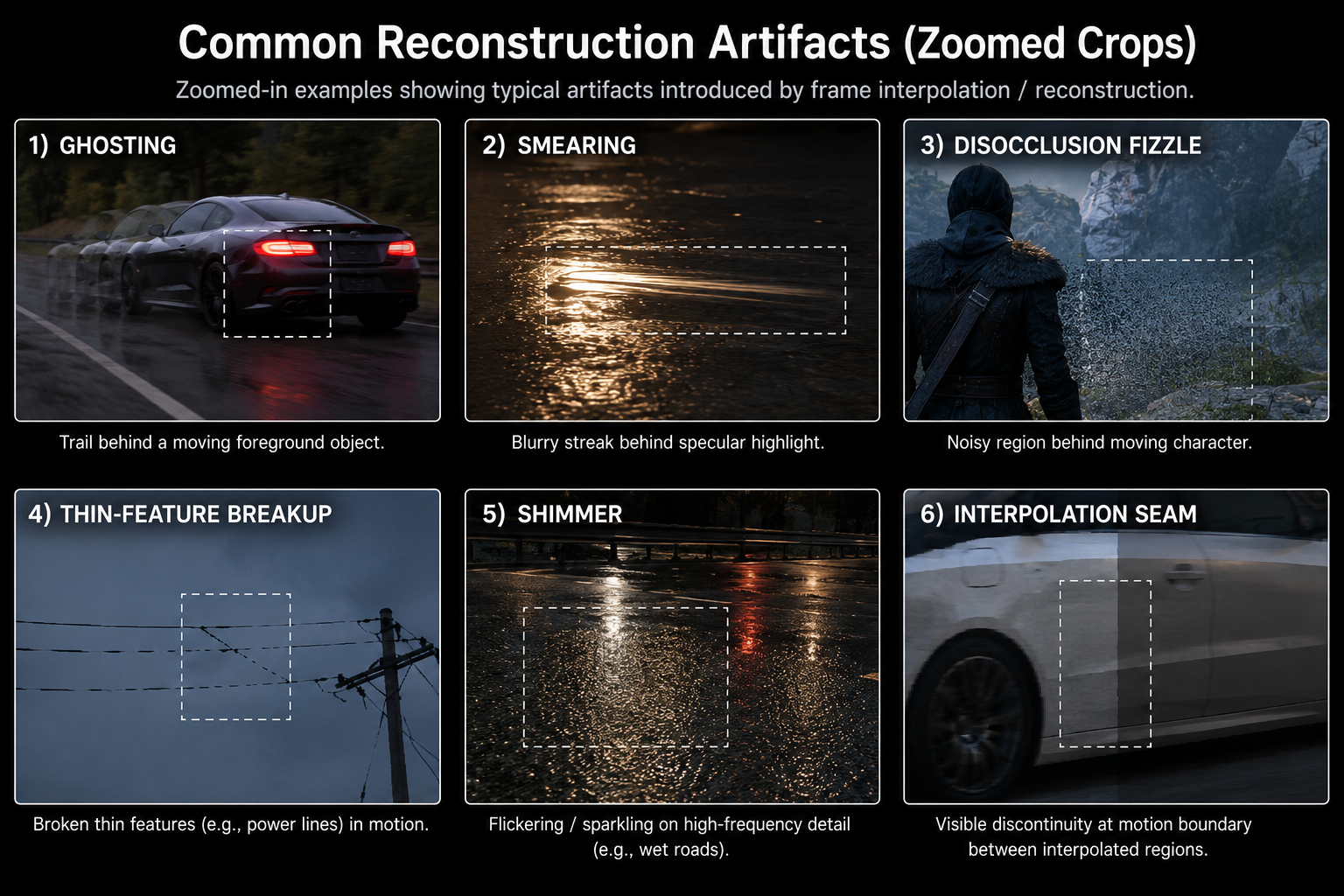

Tassonomia degli artefatti

Un vocabolario preciso per cosa va storto:

Ghosting

Una scia tenue dietro un oggetto in movimento. Causa: l'accumulatore di history continua a mescolare pixel stantii perché o (a) il motion vector sotto la scia è sbagliato e la validazione della history è stata ingannata, o (b) la rete non è riuscita a rilevare la disocclusion.

Dove vederlo: dietro oggetti veloci in primo piano contro sfondi uniformi. Peggio su superfici trasparenti, particelle ed effetti visivi che i motion vector del motore non descrivono.

Smearing

Una striscia sfocata lungo la direzione del movimento. Come il ghosting ma peggio e più direzionale. Causa: la rete ha mediato troppi campioni di history in una regione dove il movimento era stimato in modo scorretto, sbavando ogni contributo lungo il percorso sbagliato.

Dove vederlo: dietro highlight speculari in movimento, dietro ombre di oggetti in movimento (specialmente sui titoli PC con MV del motore ma senza optical flow), e su superfici riflettenti in movimento.

Fizzle di disocclusion

Una regione rumorosa o "rotta" rivelata quando qualcosa viene scoperto. Causa: finché non si accumulano abbastanza nuovi campioni, la rete ha solo uno o due campioni low-res con jitter su cui lavorare in quella regione, quindi ricade su una ricostruzione quasi spaziale senza anti-aliasing.

Dove vederlo: dietro un personaggio in movimento contro uno sfondo complesso, o quando la camera gira e scopre una nuova regione.

Rottura delle feature sottili

Linee elettriche, antenne, capelli, fili di recinzione sfarfallano, si trattegiano o spariscono in movimento. Causa: la feature è sub-pixel a risoluzione interna; a fattori di upscaling più alti non contribuisce a abbastanza campioni con jitter; la rete si arrende e tratta i pixel come rumore.

Dove vederlo: panoramica oltre geometria distante, o in dettaglio 3D fine a preset DLSS più bassi.

Shimmer / aliasing temporale

Un pattern sfarfallante su dettaglio di texture ad alta frequenza, specialmente riflessi speculari su superfici ruvide. Causa: quando né l'accumulazione in stile TAA né il filtraggio della rete converge, la variazione per-frame nelle posizioni dei campioni produce rumore visibile.

Dove vederlo: strade bagnate di notte, superfici d'acqua, fogliame distante.

Artefatti specifici della frame-generation

Quando attivi la Frame Generation, appaiono due classi aggiuntive:

- Cuciture di interpolazione: al confine tra regioni con movimenti molto diversi (un oggetto in primo piano contro uno sfondo che si muove in direzione opposta), il frame generato può avere una piccola discontinuità visibile. È la maschera di confidenza della rete che fallisce.

- Ghosting della UI: coperto nel capitolo 9. La miglior soluzione è comporre la UI dopo FG.

- Stutter sub-frame: anche quando il frame rate medio è alto, la spaziatura tra frame generati e renderizzati potrebbe non essere perfettamente uniforme, causando un "tick" ritmico a bassa frequenza che sembra uno stutter molto lieve.

Diagnosticare gli artefatti sul campo

Dato uno screenshot o un video di un glitch, puoi quasi sempre identificare la causa:

- L'artefatto si muove con un oggetto? Probabilmente motion vector sbagliati per quell'oggetto. Probabile bug lato motore.

- Appare solo a preset DLSS più bassi? Problema di feature sub-pixel; la risoluzione interna è troppo bassa per mantenere la feature.

- Appare solo con FG attivo, ma non negli still? Rete di interpolazione in difficoltà di solito con una regione in cui la stima del flow è ambigua (trasparenza, riflesso, particelle).

- Appare subito dopo un taglio o teletrasporto di camera? Disocclusion / reset della history. Inevitabile; di solito si pulisce in 4–8 frame.

- Scintilla negli still statici? Stabilità temporale inadeguata. Di solito sistemato da una DLL aggiornata.

È la stessa checklist che Digital Foundry e simili usano per i breakdown tecnici che hai visto. Ora sai a cosa stanno davvero guardando.

Cosa può fare il motore al riguardo

Una quantità sorprendentemente grande di "qualità DLSS" è in realtà qualità di integrazione nel motore. I fix lato motore che contano di più:

- Motion vector corretti per tutto, comprese particelle, ondeggio del fogliame, rifrazione screen-space, oggetti trasparenti.

- Una maschera reactive che segnala i pixel dove il cambio di aspetto non è descritto dal movimento (es. fuochi, ologrammi, decal). L'upscaler tratterà la history come meno affidabile lì.

- Una maschera di disocclusion se il motore può predire dove i pixel saranno appena rivelati (es. porte che si aprono).

- Valore di esposizione corretto passato ogni frame DLSS mappa internamente in uno spazio percettivo usando questo, e sbagliarlo causa flicker.

- UI composta a risoluzione di output dopo l'upscaler, non prima.

- Smoothing dell'auto-esposizione per pixel, altrimenti cambi improvvisi di esposizione causano flicker globale.

I giochi che fanno questo bene (es. Alan Wake 2, Cyberpunk post-patch, titoli Unreal Engine 5.4+ moderni) shippano implementazioni DLSS che possono genuinamente sembrare meglio del nativo. I giochi che non lo fanno (lanci anticipati con bug nei motion vector nella vegetazione o nei capelli) shippano con gli artefatti di cui tutti si lamentano.

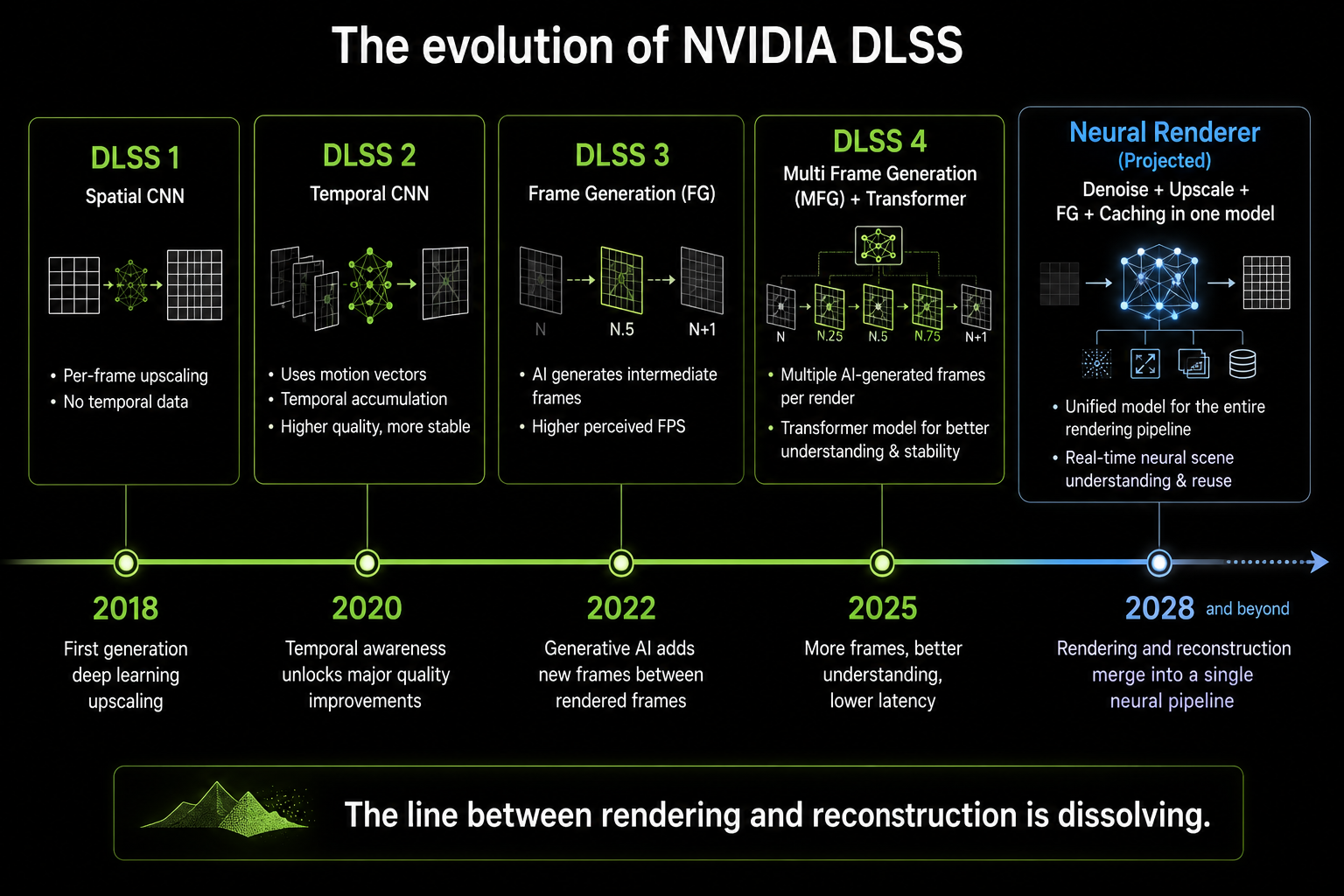

Dove sta andando questo

La ricostruzione non è finita. Trend reali da seguire nel 2026–2028:

1. Denoiser ray-tracing neurali che sostituiscono i denoiser classici

Questo è già ben avviato: DLSS 3.5 Ray Reconstruction sostituisce già il denoiser path-traced del motore con una rete neurale. Le versioni future integreranno denoising, upscaling e frame generation in un singolo modello multi-uso. La separazione netta tra "render" e "reconstruct" si ammorbidirà.

2. Frame generati in contesti latency-sensitive

La ragione per cui FG è brutta per gli sparatutto competitivi è la latenza aggiunta. Se la rete potesse estrapolare invece che interpolare predire il frame N+1 da N e N-1 senza aspettare che N+1 venga renderizzato la penalità di latenza sparirebbe. Sia NVIDIA che AMD hanno ricerca pubblica che mostra che l'estrapolazione è possibile al costo di più artefatti sui movimenti veloci. Aspettati che emergano tecniche tipo "Reflex Frame Warp" o "Frame Warp 2".

3. Caching neurale cross-frame

La maggior parte dei pixel di un frame non cambia molto da un frame all'altro. Se il motore potesse cachare risultati intermedi costosi (es. global illumination in posizioni sparse di probe) e lasciare che la rete li interpoli, il costo per frame di illuminazione di alta qualità potrebbe scendere drasticamente. La ricerca "Neural Radiance Cache" di NVIDIA e la ricerca "Neural Supersampling" di AMD puntano entrambe in questa direzione.

4. Neural shader

Sostituire parti della valutazione BRDF stessa con una piccola rete neurale. Già nella ricerca (Neural Texture Compression di NVIDIA, Neural Materials di AMD) e cominciando ad apparire nei giochi shippati. La linea tra "rendering" e "inferenza ML" si confonderà ulteriormente.

5. Convergenza tra console e PC nella ricostruzione

La PS5 Pro ha dimostrato che le console avranno upscaler neurali. La prossima Xbox è probabile ne shippi uno. La Game Mode di Apple in macOS sta cominciando a esporre MetalFX, che sta convergendo sulle stesse tecniche. Entro la fine del decennio essenzialmente ogni gioco su ogni piattaforma girerà attraverso qualche forma di ricostruzione neurale. Il rendering nativo ogni pixel calcolato ogni frame sarà di nicchia, possibilmente del tutto estinto.

Un pensiero di chiusura

La grafica real-time ha iniziato decidendo che la forza bruta era il modo per disegnare il mondo: spara un raggio (o rasterizza un triangolo), calcola un colore, scrivi un pixel, ripeti otto milioni di volte per frame. Per 30 anni, ogni avanzamento grafico è venuto dal fare più lavoro, più intelligentemente, più veloce.

La frame generation è il momento in cui quel approccio ha smesso di funzionare. Abbiamo battuto un muro. La frontiera interessante si è spostata da "calcola più pixel accuratamente" a "calcola meno pixel e predici il resto da prior appresi su come sono fatti i pixel". L'intera industria ha cambiato direzione. DLSS, FSR, XeSS e PSSR sono la stessa idea, implementata con vincoli diversi, da team diversi, su silicio diverso e non sono un hack temporaneo. Sono il nuovo substrato della grafica real-time.

Se capisci accumulazione temporale, motion vectors, ricostruzione neurale e il trade-off tra interpolazione ed estrapolazione, capisci il fondamento su cui tutto sarà costruito per il prossimo decennio. Benvenuto nella nuova pipeline.